Meta paskelbia kodą atviros prieigos dirbtiniame intelekte pavadinimu vaizdo įrišimas, kuris numato ryšius tarp duomenų, panašių į tai, kaip žmonės suvokia ar įsivaizduoja savo aplinką. Nors vaizdų generatoriai, tokie kaip Midjourney, Stable Diffusion ir DALL-E 2, susieja žodžius su vaizdais, todėl galite kurti vaizdines scenas remiantis tik tekstiniu aprašymu, o „ImageBind“ neapsiriboja tuo. Jis gali susieti tekstą, vaizdus ar vaizdo įrašus, garsą, 3D matavimus, temperatūros duomenis ir judėjimo duomenis – ir tai daro be išankstinio mokymo bet kokia proga. Tai ankstyvas sistemos etapas, kuris ilgainiui galės sukurti sudėtingas aplinkas iš paprastų įvesties elementų, pvz., teksto raginimo, vaizdo ar garso (arba jų derinio).

Galite galvoti apie „ImageBind“ kaip mašininio mokymosi prilyginimą žmogaus mokymuisi. Pavyzdžiui, jei stovite dinamiškoje aplinkoje, pavyzdžiui, judrioje miesto gatvėje, jūsų smegenys (dažniausiai nesąmoningai) sugeria vaizdus, garsus ir kitus jutimo pojūčius, kad gautų informaciją apie pravažiuojančius automobilius, aukštus pastatus, orą ir kt. . Žmonės ir kiti gyvūnai evoliucionavo, kad apdorotų šiuos duomenis mūsų genetiniams pranašumams: išlikimui ir mūsų DNR perdavimui. (Kuo daugiau žinosite apie savo aplinką, tuo daugiau galėsite išvengti pavojų ir prisitaikyti prie savo aplinkos, kad geriau išgyventumėte ir klestėtumėte). Kompiuteriams priartėjus prie multisensorinių gyvūnų jungčių imitavimo, jie gali naudoti tuos ryšius, kad sukurtų visiškai realizuotas scenas, pagrįstas tik ribotais duomenimis.

Taigi, nors galite naudoti „Midjourney“, kad sukurtumėte „basetą su Gandalfo kostiumu, balansuojantį ant paplūdimio kamuolio“ ir gautumėte gana tikrovišką tos keistos scenos nuotrauką, tačiau naudojant multimodalinį AI įrankį, pvz., „ImageBind“, gali būti sukurtas vaizdo įrašas su šunimi su atitinkama informacija. garsai, įskaitant išsamią svetainę, kambario temperatūrą ir tikslią šuns bei visų kitų įvykio vietą. „Tai sukuria puikią galimybę kurti animacijas iš statinių vaizdų, derinant jas su garso raginimais“, – savo kūrėjams skirtame tinklaraštyje pažymi „Meta“ tyrėjai. „Pavyzdžiui, kūrėjas gali sujungti vaizdą su žadintuvu ir giedančiu gaidžiu ir naudoti garso signalą, kad segmentuotų gaidį, arba žadintuvo garsą, kad segmentuotų laikrodį ir animuotų abu vaizdo įrašų sekoje.

Kalbant apie tai, ką dar galima padaryti su šiuo nauju žaislu, tai aiškiai rodo vieną iš pagrindinių „Meta“ ambicijų: VR, mišrią realybę ir metaerdvę. Pavyzdžiui, įsivaizduokite būsimas ausines, kurios gali sukurti visiškai realizuotas 3D scenas (su garsu, judesiu ir pan.). Arba virtualių žaidimų kūrėjai galiausiai galėtų jį panaudoti, kad sutaupytų didelę kruopštaus darbo dalį projektavimo procese. Taip pat turinio kūrėjai gali kurti įtraukiančius vaizdo įrašus su tikrovišku garso takeliu ir judesiais, pagrįstus tik tekstu, vaizdais ar garsu. Taip pat nesunku įsivaizduoti, kaip toks įrankis kaip „ImageBind“ atveria naujas prieinamumo duris generuodamas daugialypės terpės aprašymus realiuoju laiku, kad padėtų žmonėms, turintiems regėjimo ar klausos sutrikimų, geriau suprasti savo aplinką.

Taip pat įdomu: Geriausi įrankiai, pagrįsti dirbtiniu intelektu

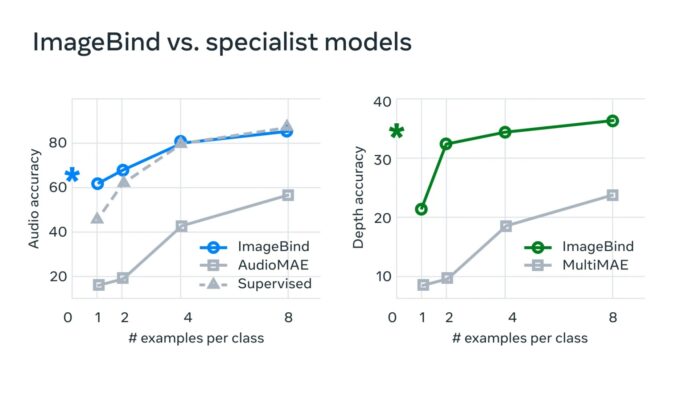

„Įprastose AI sistemose kiekvienam atitinkamam modalumui yra specialus įterpimas (ty skaičių vektoriai, galintys parodyti duomenis ir jų ryšius mašininio mokymosi metu), – sako Meta. „ImageBind rodo, kad galima sukurti bendrą įterpimo erdvę keliems būdams, nereikia lavinti duomenų naudojant kiekvieną individualų modalumo derinį. Tai svarbu, nes mokslininkai negali sukurti duomenų rinkinių su pavyzdžiais, kuriuose būtų, pavyzdžiui, garso ir šilumos duomenys iš judrios miesto gatvės arba gylio duomenys ir tekstinis pajūrio skardžio aprašymas.

Meta mano, kad ši technologija ilgainiui peržengs dabartinius šešis „jutimus“, taip sakant. „Nors savo dabartiniame tyrime ištyrėme šešis būdus, manome, kad įdiegus naujus būdus, jungiančius kuo daugiau pojūčių, pvz., lytėjimo, kalbos, kvapo ir fMRI smegenų signalų, bus sukurti turtingesni į žmogų orientuoti AI modeliai. Kūrėjai, norintys ištirti šią naują smėlio dėžę, gali pradėti pasinerti į Meta atvirojo kodo kodą.

Taip pat skaitykite: